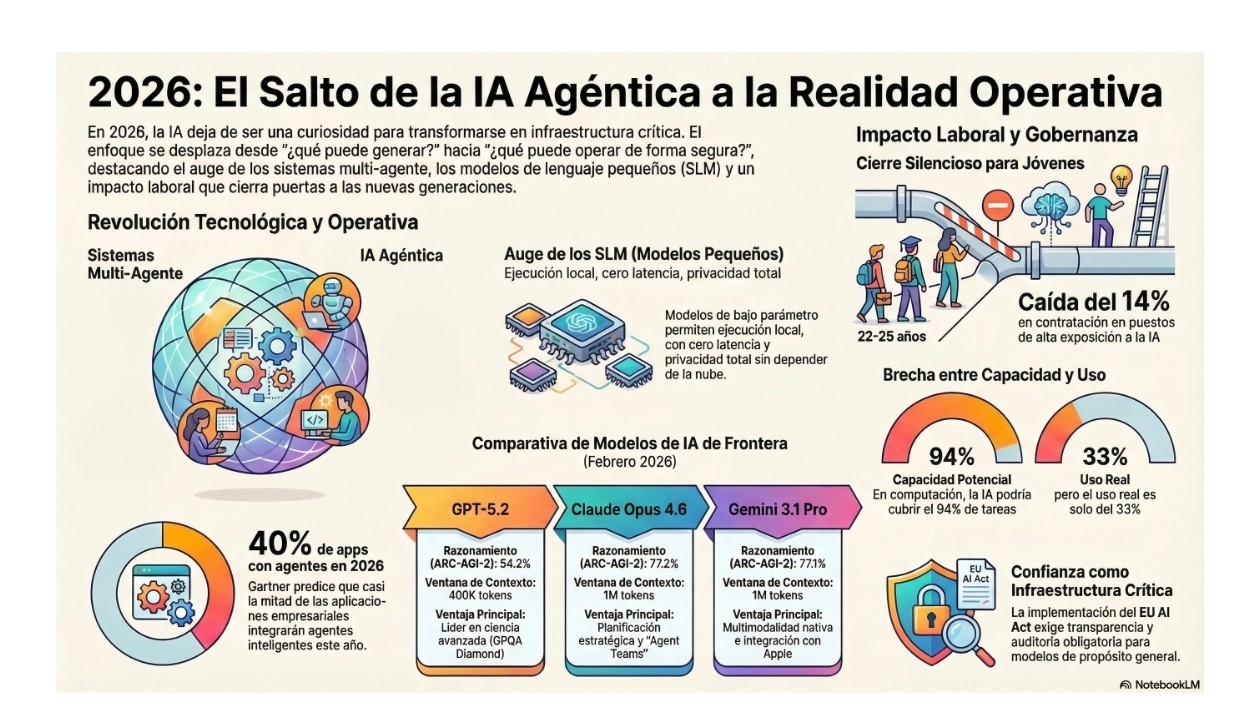

El año 2026 marca el fin de la fascinación técnica y el inicio de la resiliencia operativa. La IA ha dejado de ser una curiosidad de laboratorio para mutar en el sistema nervioso de la infraestructura crítica. Según el informe de tendencias de Gartner, el eje estratégico se ha desplazado del «¿qué puede hacer?» al «¿cómo se opera de forma segura?». Con modelos como Gemini 3.1 Pro alcanzando un 77.1% en el benchmark ARC-AGI-2 y ofreciendo una ventana de contexto de un millón de tokens, la capacidad de procesamiento ya es masiva. Este salto, consolidado por el acuerdo Apple-Google que integra a Gemini en 1.800 millones de dispositivos, traslada la IA de las nubes privadas a las agendas de seguridad nacional.

Sin embargo, esta madurez tecnológica está fracturando el contrato social a través de una «puerta silenciosa» en el mercado laboral. El estudio de Anthropic, Labor market impacts of AI, revela que no asistimos a un tsunami de despidos, sino a un desplazamiento generacional. La contratación de jóvenes (22-25 años) en sectores de alta exposición ha sufrido una caída del 14%. El dato es punzante: la IA ya cubre el 75% de las tareas de programación. No estamos ante la automatización de tareas manuales, sino ante una eficiencia privada que asfixia a la clase profesional educada —abogados y analistas con posgrado—, comprometiendo el relevo generacional de las élites intelectuales.

En el plano geopolítico, el cisma entre el Pentágono y Anthropic personifica la lucha por el mando. La designación de Anthropic como «riesgo en la cadena de suministro» por parte de la administración Trump, tras la negativa de Dario Amodei a aceptar cláusulas de «cualquier uso legal», marca el fin de la luna de miel entre Silicon Valley y Washington. La disputa es por el control total: con Claude Opus 4.6 liderando el benchmark OSWorld (72.7%), la IA ya posee la autonomía para operar interfaces de ordenador sin supervisión. Frente a este modelo de disciplina militar estadounidense, surge el modelo europeo:

- Soberanía Tecnológica: Indra Group orquesta la «IA líquida» (agéntica) a través de IndraMind, una plataforma diseñada para proteger infraestructuras críticas mediante redes de agentes autónomos.

- Regulación Estricta: El EU AI Act entra en fase crítica, exigiendo auditorías obligatorias a modelos de propósito general (GPT-5.3, Gemini 3.1) para evitar la captura regulatoria.

El Informe Internacional sobre Seguridad de la IA de Yoshua Bengio advierte que la brecha entre el avance técnico y las salvaguardas es ya un riesgo existencial. La Declaración Pro-Humana de IA exige un imperativo: mantener el human-in-the-loop y un «kill switch» operativo. La tecnología ya escaló; ahora es la política la que debe escalar para impedir que la autonomía algorítmica erosione definitivamente la soberanía del Estado.